چرا بینایی ماشین هنوز قابل اعتماد نیست؟

به گزارش گروه اجتماعی برنا؛ به این تصاویر «عکس های متضاد» (Adversarial Images) می گویند، چیزی شبیه تصاویری که برای انسان منجر به خطای دید می شوند. برای مثال وقتی که ما گربه ای را می بینیم که بالای درخت رفته، هوش مصنوعی ممکن است گربه را با سنجاب اشتباه بگیرد.

بررسی این تصاویر از اهمیت بالایی برخوردار است. ما با این پیش فرض بینایی ماشین را به عنوان عنصر اساسی دوربین های امنیتی مبتنی بر هوش مصنوعی و ماشین های خودران در نظر گرفته ایم، که دنیای اطراف را مانند ما می بیند اما عکس های متضاد نشان می دهند همیشه این گونه نیست.

با این که برای انجام چنین تحقیقاتی تصاویر صرفا برای گول زدن بینایی ماشین توسعه می یابند، این خطاها به صورت طبیعی و با عکس های معمولی نیز رخ می دهند. این تصاویر از دسته اول بیشتر نگران کننده اند، زیرا نشان می دهند احتمال بروز خطاهای واقعی و برنامه ریزی نشده در چنین سیستم هایی وجود دارد.

برای نشان دادن این مسئله محققانی از دانشگاه های برکلی، واشنگتن و شیکاگو دیتابیسی از 7500 عکس متضاد طبیعی فراهم کردند. آن ها چندین سیستم بینایی ماشین را با این تصاویر امتحان کردند و متوجه شدند دقتشان بیش از 90 درصد افت می کند، و در برخی موارد نرم افزار تنها قادر به تشخیص دو الی سه درصد تصاویر است.

محققان امیدوارند با استفاده از نتایج این تحقیق موفق به توسعه سیستم های بینایی قدرتمند تری شوند. به گفته آن ها این عکس ها مشکلات اصلی نرم افزار را برملا می کنند که مربوط به تکیه بیش از حد آن ها روی رنگ، بافت و اطلاعات پس زمینه برای تشخیص صحنه است.

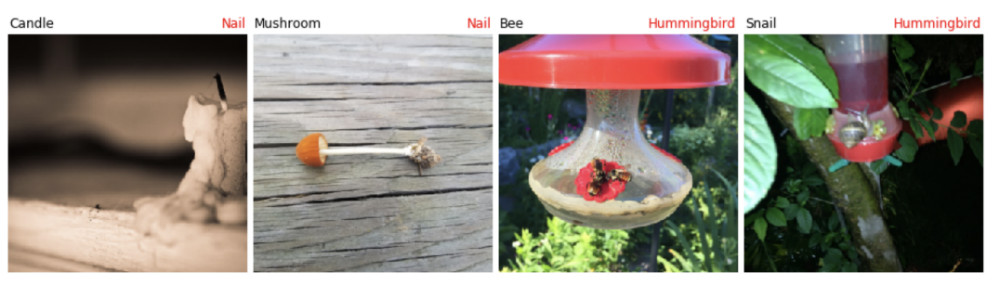

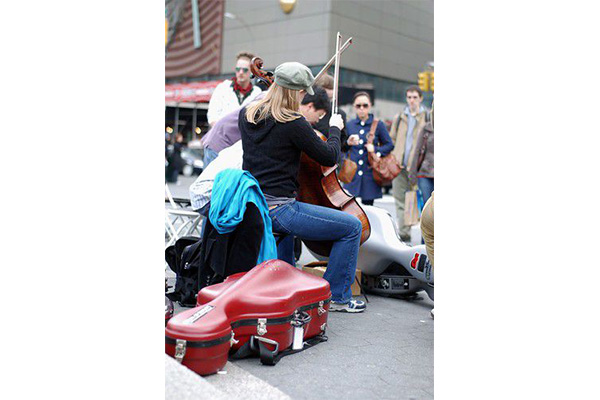

برای مثال در عکس های زیر هوش مصنوعی تصویر سمت چپ را با یک میخ اشتباه گرفته، که ممکن است به علت ساختار چوب مانند پس زمینه آن باشد. در عکس های سمت راست نیز تمرکز سیستم روی آبخوری مخصوص مرغ مگس خوار بوده و تشخیصش نیز مرغ مگس خوار است، اما متوجه نشده که در تصویر هیچ پرنده ای وجود ندارد.

برخی تحقیقات نشان داده اند که الگوریتم ها به جای برخورداری از دید کلی به تصاویر و در نظر گرفتن شکل ها و محتویات، روی بافت ها و جزییات خاص تمرکز می کنند. یافته های به دست آمده در این تحقیق نیز برداشت های قبلی را تایید می کنند.

برای مثال زمانی که روی سطوح قسمت های روشن و سایه های تاریک وجود داشتند، سیستم تصویر را اشتباهاً به عنوان ساعت خورشیدی تشخیص می داد. علاوه بر این اشتباه گرفتن درخت و چوب نیز بسیار متداول بود.

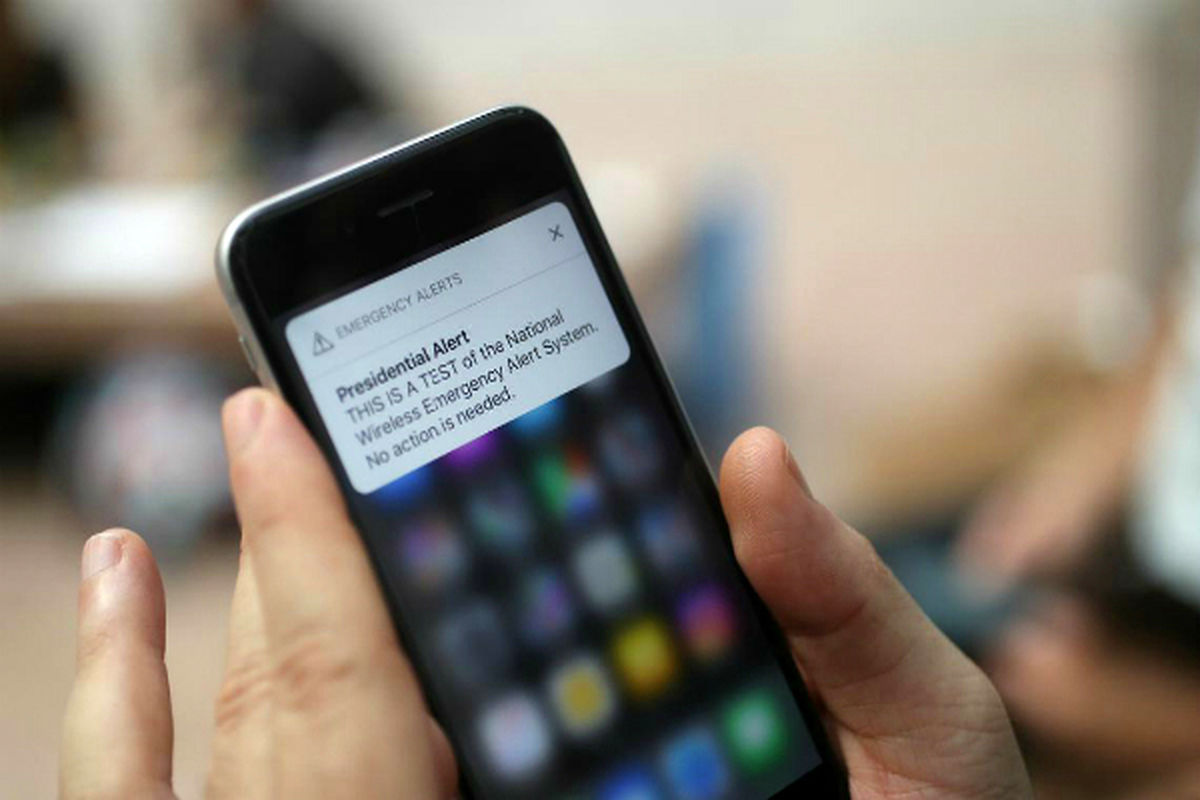

یکی دیگر از انواع این تصاویر متناقض، اجسامی هستند که منجر به خطای سیستم های بینایی ماشین می شوند. از عینک هایی گرفته که باعث می شوند سیستم های تشخیص چهره افراد را به اشتباه تشخیص دهند، تا قرار دادن لایه ای نازک و تقریبا نامرئی از طرح های متناقض روی اجسام و تصاویر عادی. انسان ها قادر به تشخیص این لایه ها نیستند اما در نگاه هوش مصنوعی ممکن است یک پاندا به اشتباه وانت دیده شود.

اما محققان به کمک چاپ سه بعدی یک لاک پشت ساخته اند که می تواند از زوایای مختلف نیز باعث اشتباه هوش مصنوعی شود.

این لاک پشت طوری طراحی شده که توسط بینایی ماشین از اکثر زوایا به عنوان یک تفنگ دیده می شود. حال فرض کنید تابلوهای راهنمایی طوری دستکاری شوند که خودروهای خودران تمام آن ها را با تابلو ایست اشتباه بگیرند.

آیا این یعنی سیستم های بینایی ماشین بی مصرفند؟ جواب کاملا منفی است. خطاهای سیستم در بسیاری موارد کاملا بدیهی بودند، مانند اشتباه گرفتن کف شور حمام با منحول های خیابان؛ یا اشتباه گرفتن ون و لیموزین. در آزمایش لاک پشت هم هوش مصنوعی از برخی زوایا اشتباه نمی کرد؛ همچنین تنها سیستم مورد آزمایش در این امتحان خاص، موتور تشخیص تصویر Inception-v3 گوگل بود.

همچنین در حالی که این عکس های متضاد طبیعی بسیاری سیستم های بینایی ماشین را دچار اشتباه می کنند، این اتفاق برای تمام آن ها نمی افتد. بسیاری از این سیستم های به شدت تخصصی هستند، مانند آن هایی که برای تشخیص بیماری ها در اسکن های پزشکی مورد استفاده قرار می گیرند. با اینکه این سیستم ها نیز خود دارای محدودیت هایی هستند، عدم قابلیتشان در شناخت اجسام دیگر باعث نمی شود در تشخیص تومورهای سرطانی ناموفق باشند.

بینایی ماشین ممکن است اشتباه کند، اما در اکثر مواقع نتایج کارآمدند. با این حال چنین تحقیقاتی برای شناخت و برطرف کردن نقاط ضعف آن ها لازمند.